从价格战到价值战:AI算力涨价潮背后的技术经济学深度解析

2023年初,笔者第一次在内部技术会上提出"算力即权力"这个判断时,台下响起的更多是质疑声。彼时云计算市场的价格战正如火如荼,没有多少人会相信算力有一天会成为稀缺商品。

时间回溯:价格屠刀下的算力认知

回望过去五年,国内云计算市场经历了一场史无前例的价格血洗。阿里云、腾讯云、华为云轮番上阵,CDN单价从每GB0.15元杀到0.05元,存储价格腰斩再腰斩。这种烧钱换市场的打法,在移动互联网时代或许有效——毕竟彼时的算力边际成本趋近于零,流量变现路径清晰。

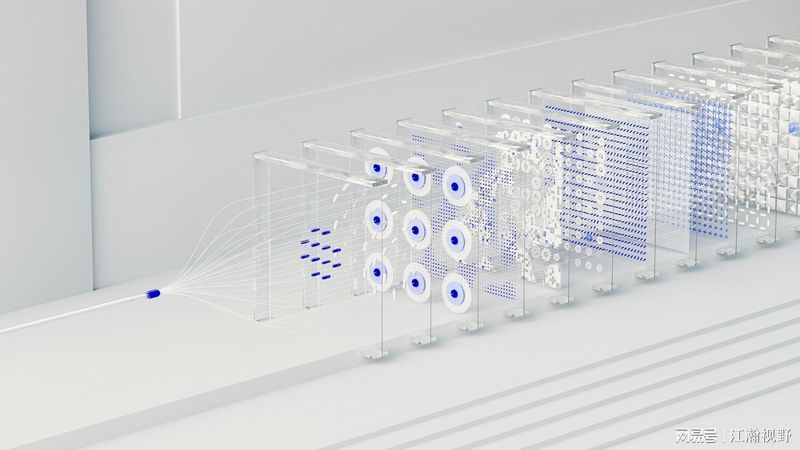

然而,AI大模型的崛起彻底改变了这套逻辑。Transformer架构的训练需要海量的GPU集群,推理过程对HBM内存带宽的要求远超传统服务器。当BERT、GPT系列模型开始商业化部署时,算力消耗从"涓涓细流"瞬间变成"汪洋大海"。

关键节点:四次涨价潮的技术驱动力

2024年Q3是第一个转折点。OpenAI发布GPT-4o后,国内厂商猛然发现单次对话的Token消耗量是GPT-3.5的15倍以上。用户行为的根本性转变——从简单问答到多轮推理——直接导致了算力成本的非线性增长。

2025年初是第二个节点。Anthropic发布Claude3.7,引入超长思维链机制,让Token消耗量再次翻番。紧接着,国产大模型厂商跟进,GLM-4、Qwen-2.5、文心4.0相继迭代,每一次更新都意味着推理成本的上升。

2025年Q2达到临界点。AWS、谷歌云率先对EC2和CDN服务提价15%-100%。国内厂商随即跟进:阿里云AI算力涨幅34%,腾讯混元模型输入价格涨幅463%,智谱GLM-5.1涨价10%且这已是年内第三次调价。

经验总结:供需结构的三重断裂

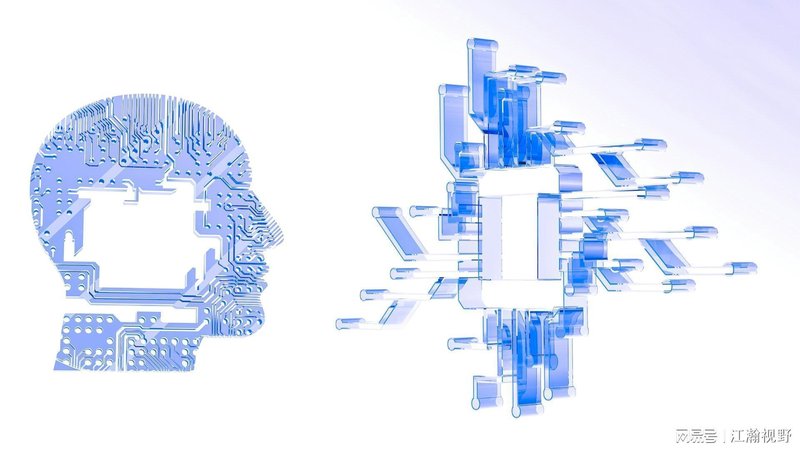

本轮涨价潮的本质,是供需结构发生了三重断裂。第一重断裂发生在需求侧:AI智能体的普及使得单用户Token消耗量从日均几百Tokens飙升至数万Tokens,需求曲线出现了垂直跃迁而非线性增长。第二重断裂发生在供给侧:HBM内存的扩产周期长达18个月以上,而GPU芯片受制于先进制程产能,物理层面的供给弹性极低。第三重断裂发生在定价逻辑上:传统云计算的规模效应无法覆盖AI算力的边际成本增长,以价换量的商业模式已然失效。

方法提炼:企业应对策略框架

面对算力成本上涨,企业需要建立三层应对体系。首先是架构优化层:通过模型蒸馏、量化压缩、知识蒸馏等技术手段,在保持模型能力的前提下将推理成本降低40%-60%。其次是资源调度层:建立动态算力分配机制,在业务低峰期释放冗余算力,高峰期采用弹性扩容而非预留固定资源。第三是商业策略层:采用分层定价模型,对实时性要求高的核心业务采用高优先级计算,对批处理任务采用离线低优先级模式。

应用指导:实践中的关键变量

笔者近期与多家科技公司CTO交流后,总结出三个实践中的关键变量。其一是模型选择策略:并非所有场景都需要调用最高参数的旗舰模型,针对客服、摘要等场景,7B参数的量化模型已能覆盖80%的业务需求。其二是缓存机制设计:对重复性高的Query建立Token缓存,可减少30%以上的重复计算消耗。其三是混合部署架构:将本地推理与云端调用结合,既保证数据安全又控制成本。

涨价潮的本质是行业从草莽时代进入成熟期的阵痛。告别烧钱补贴的野蛮生长,才能让真正有价值的技术创新获得应有的回报。